[인텔 이노베이션 2023] 실리콘과 SW가 견인하는 ‘실리코노미’ 시대···AI가 견인

[테크수다 기자 도안구 eyeball@techsuda.com] 팻 겔싱어(Pat Gelsinger) 인텔 CEO는 “인공지능은 세대교체를 의미한다. 컴퓨팅은 모두를 위한 더 나은 미래의 기반으로서 더욱 중요해지고 있으며, 이는 글로벌 확장 새시대의 서막을 알리는 것”이라며 “또한, 개발자에게 가능성의 한계를 뛰어넘어 세계 최대 난제를 해결하고 지구의 모든 인류의 삶을 개선할 수 있는 엄청난 사회적 그리고 사업적 기회를 제공한다”고 말했다.

인텔은 현지시간 19일 연례 개발자 행사인 세번째 인텔 이노베이션(Intel Innovation)을 미국 캘리포니아주 산호세에서 개최했다고 밝혔다. 인텔은 올해 행사에서 클라이언트, 엣지, 네트워크와 클라우드에 이르는 모든 워크로드에서 인공지능 접근성을 높이고 사용할 수 있도록 지원하는 다양한 기술을 공개했다.

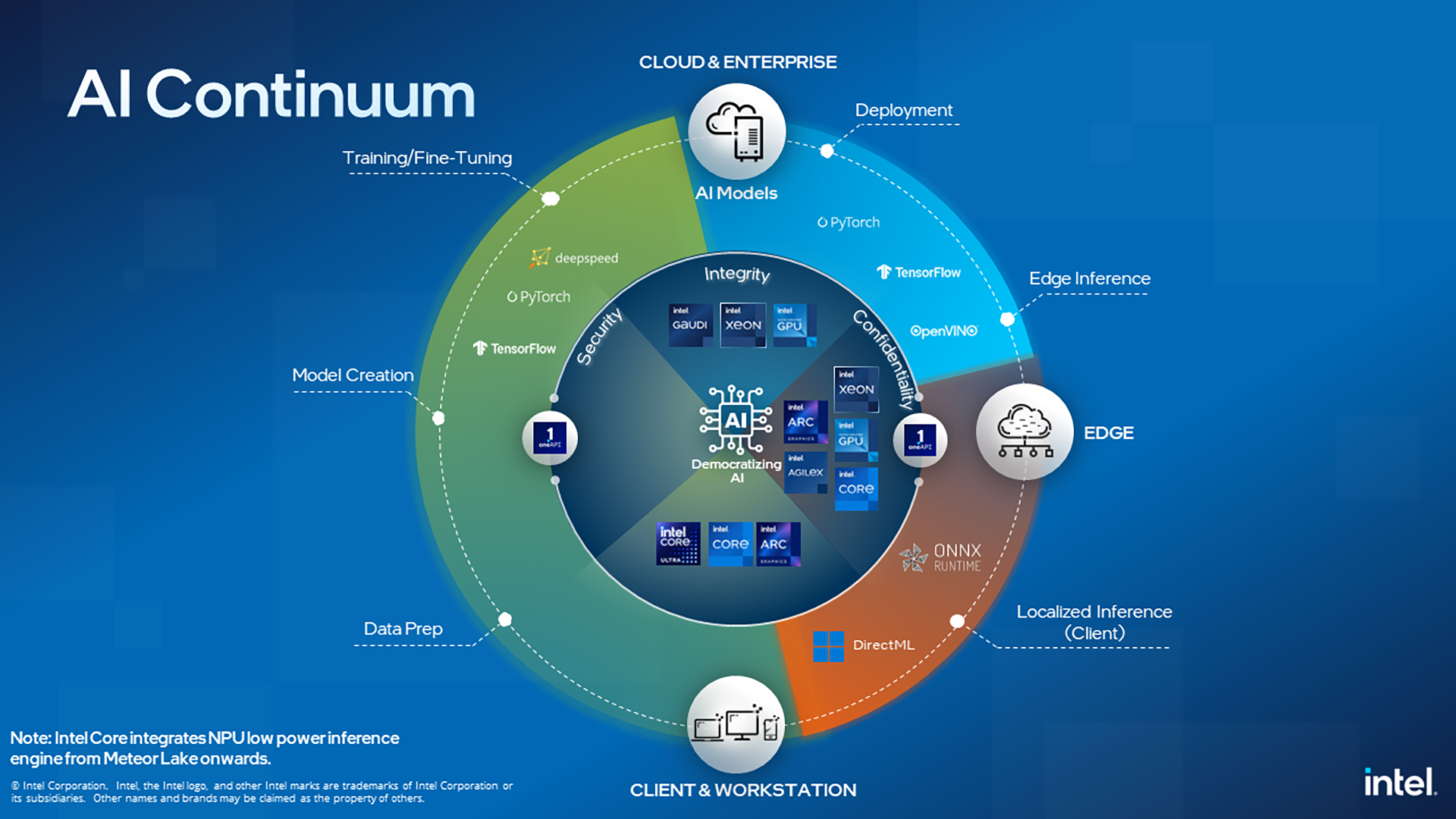

겔싱어 CEO는 개발자를 위한 기조연설을 통해 인텔이 하드웨어 제품 전반에 걸쳐 AI 기능을 제공하고 있음을 밝히고 오픈소스 기반 멀티 아키텍처 소프트웨어 솔루션을 통해 AI 기능을 활용하는 방법에 대해 소개했다.

겔싱어 CEO는 “실리콘과 소프트웨어의 마법을 통해 성장하는 경제인 실리코노미(Siliconomy)”를 AI가 견인하고 있다고 강조했다. 현재 실리콘 산업은 약 5,740억 달러 규모로 성장했으며, 현재 8조 달러 가치의 글로벌 기술 경제를 주도하고 있는 산업이다.

실리콘, 패키징, 멀티 칩렛 솔루션 부문 혁신

겔싱어 CEO는 인텔이 발표했던 4년 간 5개 노드 공정을 개발한다는 목표가 차질없이 진행되고 있다고 밝혔다. 더불어, 현재 인텔7 공정으로 이미 대량 양산이 진행 중이고, 인텔4 공정이 제조 준비를 마쳤으며, 인텔3은 올해 말까지 제조 준비를 완료할 예정이라고 밝혔다.

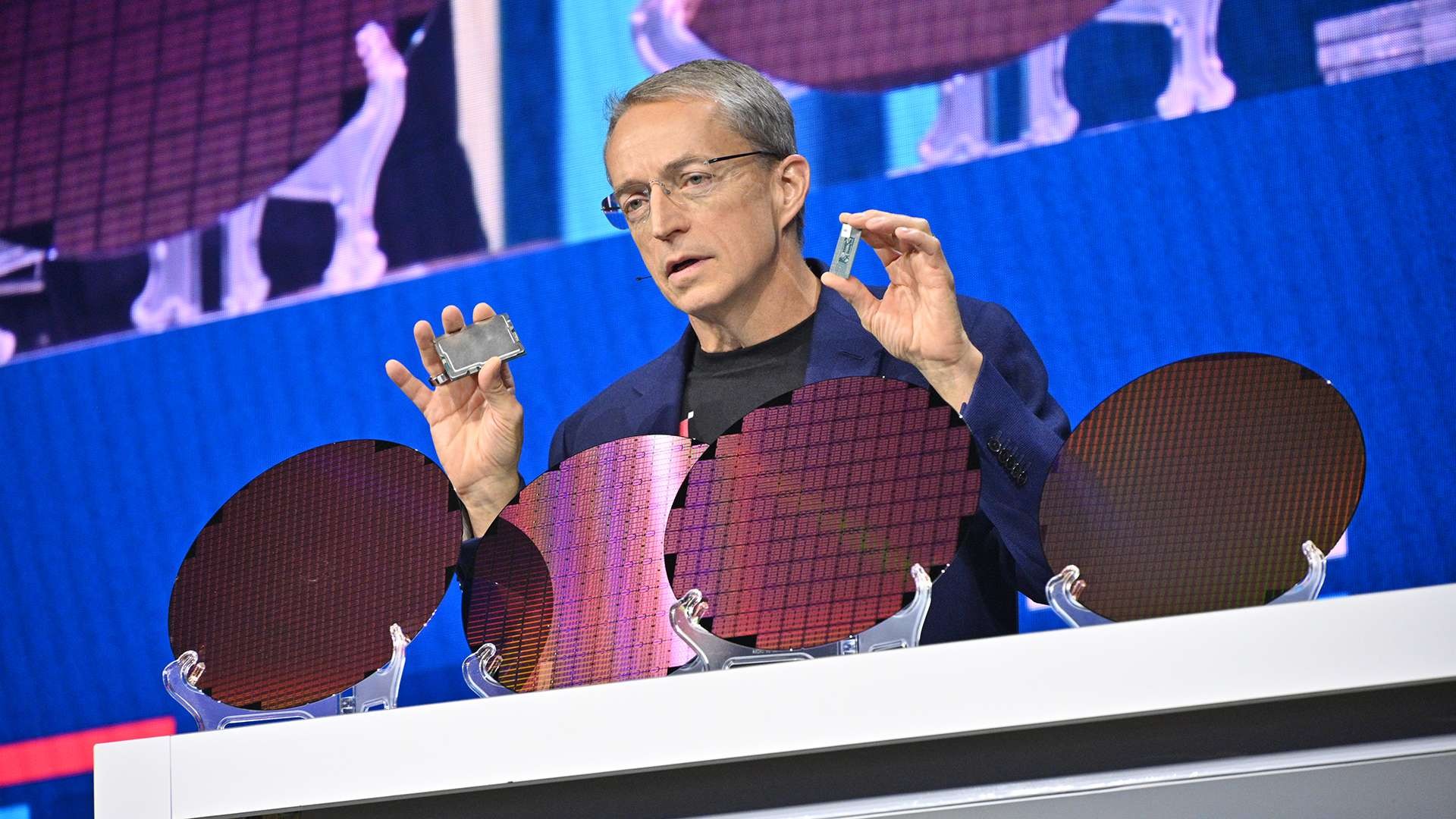

더불어, 겔싱어 CEO는 2024년 PC 시장을 공략할 인텔 애로우 레이크(Arrow Lake) 프로세서용 첫 번째 테스트 칩과 인텔20A 웨이퍼를 공개했다. 인텔20A는 후면 전력 공급 기술인 파워비아(PowerVia)와 리본펫(RibbonFET)으로 불리는 새로운 게이트 올 어라운드(GAA) 트랜지스터 디자인이 적용된 최초의 공정이다. 파워비아 및 리본펫을 활용할 두번째 공정인 인텔 18A도 2024년 하반기에 생산 준비를 완료할 전망이다.

인텔은 이번 주 발표한 또 하나의 혁신인 유리 기판과 같은 새로운 재료와 새로운 패키징 기술을 통해서 다른 방법으로 무어의 법칙(Moore’s Law)을 이어나간다. 유리 기판은 2030년 이후에도 패키지에 담을 수 있는 트랜지스터의 수를 지속적으로 증가시키며 인공지능과 같은 데이터 집약적이고 높은 성능이 필요한 워크로드 요구사항을 충족시키는 데 도움이 될 것으로 예상된다.

인텔은 이날 유니버설 칩렛 인터커넥트 익스프레스(UCIe) 기반 테스트 칩 패키지도 선보였다. 겔싱어 CEO는 개방형 표준이 IP 통합을 보다 용이하게 한다면 무어의 법칙의 다음 단계는 멀티칩렛 패키지와 함께 도래할 것이라고 밝혔다. 지난해 공개된 UCIe 표준은 다양한 공급업체가 제작한 칩렛이 함께 작동할 수 있도록 지원해 다양한 AI 워크로드의 확장을 위한 신규 설계 구현을 가능하도록 한다. 현재 UCIe 표준에는 120개 이상의 기업이 참여하고 있다.

인텔이 이날 발표한 테스트칩은 인텔3 기반 인텔 UCIe IP 칩렛과 TSMC N3E 공정 기반 시놉시스(Synopsys) UCIe IP 칩렛을 결합했다. 칩렛은 내장형 멀티다이 인터커넥트 브릿지(EMIB) 첨단 패키징 기술을 사용해 연결했다. 인텔은 기술 시연을 통해 TSMC, 시놉시스 및 인텔 파운드리 서비스(IFS)의 UCIe 기반의 개방형 표준 기반 칩렛 생태계 지원 의지를 강조했다.

성능 향상 및 어디에서나 AI를 구축하도록 확대

겔싱어 CEO는 인텔 플랫폼을 통해 개발자들에게 제공되는 다양한 AI 기술을 강조하고, 향후 몇 년 간 더욱 많은 관련 기술을 개발자들에게 제공할 것이라고 밝혔다.

최근 공개된 MLPerf AI 추론 성능 결과는 가장 크고 어려운 생성형 AI 및 대규모 언어 모델(LLM)을 포함한 AI 기술의 모든 단계를 지원하기 위한 인텔의 노력을 입증했다. 더불어, 인텔 가우디2 가속기가 AI 컴퓨팅 요구사항을 충족할 수 있는 유일한 대안이라는 점을 부각한다. 또한 겔싱어 CEO는 인텔 제온 프로세서와 4천개의 인텔 가우디2 하드웨어 가속기 기반으로 스태빌리티AI(StabilityAI)사를 위해 구축한 대규모 AI 슈퍼컴퓨터를 공개했다.

징런 저우(Jingren Zhou) 알리바바 클라우드 최고기술책임자(CTO)는 “생성형 AI 및 LLM인 알리바바 클라우드의 통이 파운데이션 모델(Tongyi Foundation Model)”에 AI 가속기를 탑재한 4세대 인텔 제온 프로세서 적용 사례를 소개했다. 그는 인텔 기술을 통해 “평균 3배 빠른1 응답 시간을 달성했다”고 밝혔다.

인텔은 이날 5세대 인텔 제온 프로세서를 12월 14일에 출시해 전 세계 데이터 센터에 더욱 향상된 성능과 더욱 빠른 메모리와의 조합을 제공할 것이라고 공개했다. 2024년 상반기 선보일 예정인 E-코어의 효율성을 갖춘 시에라 포레스트(Sierra Forest)는 4세대 제온 프로세서 대비 2.5배 높은 랙 밀도와 2.4배 높은 와트당 성능을 제공하며, 288개 코어를 갖춘 제품도 공개할 예정이다. 시에라 포레스트와 유사한 시기에 출시 예정인 고성능 P-코어 기반 그래나이트 래피즈(Granite Rapids)는 4세대 제온 프로세서 대비 2~3배 빠른 AI 워크로드 성능을 제공할 것이다.

2025년에 출시 예정인 차세대 E-코어 기반 제온 프로세서(코드명 클리어워터 포레스트)는 인텔18A 공정 기반으로 생산할 예정이다.

인텔 코어 울트라 프로세서를 탑재한 AI PC

앞으로 인공지능 기술도 더욱 개인에 맞춰 변모할 예정이다. 겔싱어 CEO는 “AI는 클라우드와 PC역량을 함께 활용해 개인 생산성과 창의성을 발휘하도록 지원하고 이를 통해 PC가 제공하는 경험을 변화시키고 재구성할 것”이라며 “인텔은 AI PC의 새 시대를 열고 있다”고 말했다.

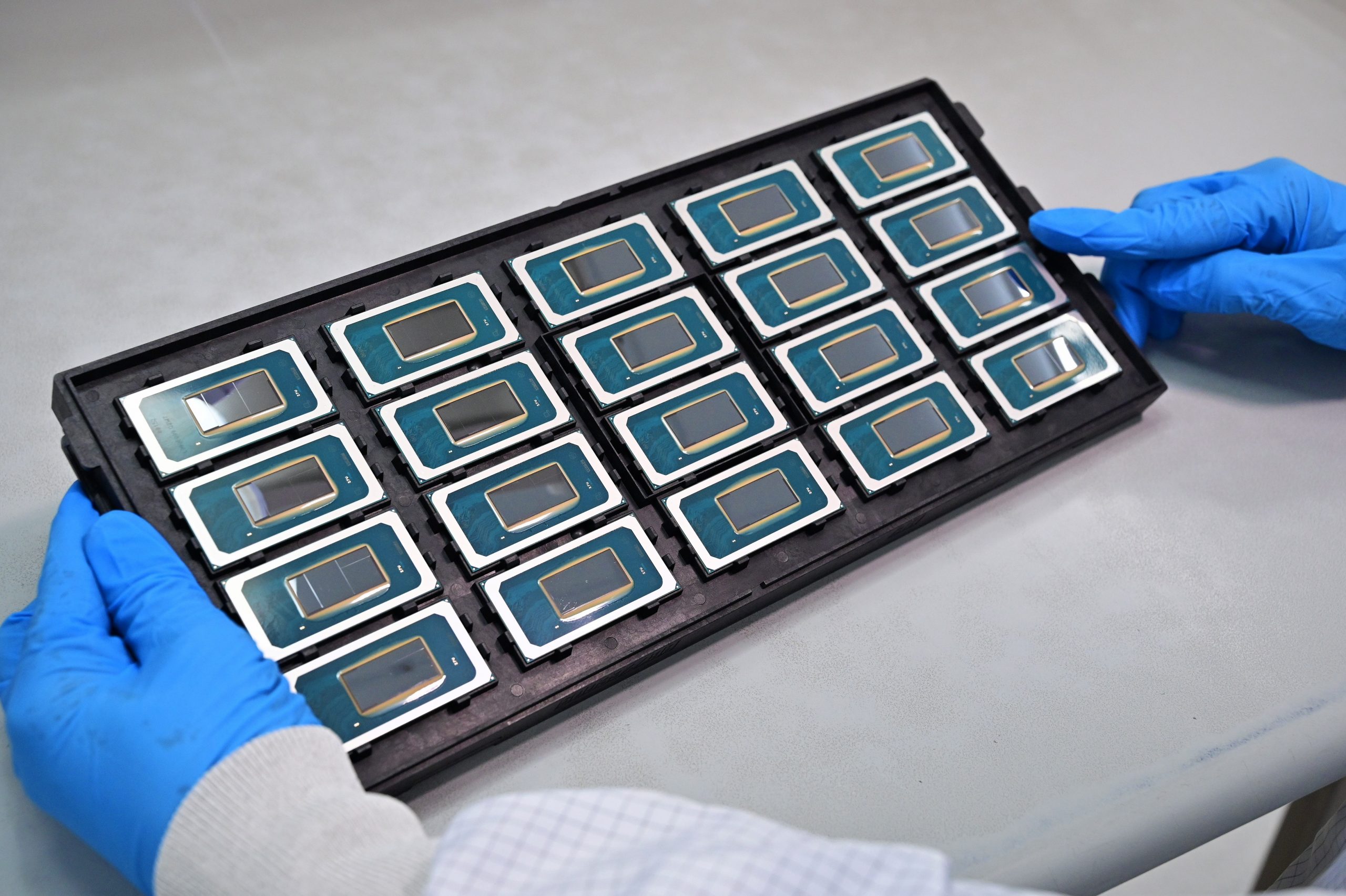

인텔은 첫 번째 통합형 신경처리장치 또는 NPU(neural processing unit)를 탑재한 인텔 코어 울트라 프로세서(코드명 메테오 레이크)를 바탕으로 새로운 PC 경험을 제공한다. NPU는 PC에서 전력 효율적인 AI 가속 및 로컬 추론 기능을 지원한다. 겔싱어 CEO는 인텔 코어 울트라 프로세서가 오는 12월 14일 출시될 것이라고 밝혔다.

인텔 코어 울트라 프로세서는 인텔 PC용 프로세서 로드맵의 주요한 기점을 나타낸다. 해당 프로세서는 인텔 포베로스(Foveros) 패키징 기술을 적용한 최초의 PC용 칩렛 기반 제품이다. NPU 및 인텔4 공정 기술을 바탕으로 전력 효율성이 크게 향상되었으며, 내장형 인텔 아크 그래픽으로 외장 그래픽과 동등한 수준의 그래픽 성능을 제공한다.

겔싱어 CEO는 무대에서 다양한 AI PC 사용 사례를 선보였으며, 제리 카오(Jerry Kao) 에이서 최고운영책임자(COO)는 곧 출시할 코어 울트라 기반 노트북을 일부 공개했다. 카오 COO는 “에이서는 인텔 코어 울트라 플랫폼을 활용하기 위해 일련의 AI 애플리케이션을 인텔과 공동 개발해 왔다”며 “하드웨어에 생명을 불어넣기 위해 오픈비노 툴킷과 공동 개발한 AI라이브러리를 사용해 개발 중이다”고 말했다.

실리코노미를 이끌어가는 개발자

겔싱어 CEO는 “앞으로의 AI는 전체 생태계에 더 높은 접근성, 확장성, 가시성, 투명성 및 신뢰를 제공해야 한다”고 말했다.

인텔은 개발자들이 이런 미래를 실현할 수 있도록 지원하기 위해 다음과 같이 발표했다:

- 인텔 개발자 클라우드 공식 출시: 인텔 개발자 클라우드(Intel Developer Cloud)는 개발자가 딥러닝용 인텔 가우디2 프로세서를 포함 최신 인텔 하드웨어 및 소프트웨어 혁신을 사용해 AI를 가속화할 수 있도록 지원하며, 5세대 인텔 제온 스케일러블 프로세서 및 인텔 데이터센터 GPU Max 시리즈 1100 및 1550과 같은 최신 인텔 하드웨어 플랫폼에 대한 액세스를 제공한다. 개발자는 인텔 개발자 클라우드를 사용해 AI 및 HPC 애플리케이션을 개발, 테스트 및 최적화할 수 있다. 또한 소규모에서 대규모의 AI트레이닝, 모델 최적화 및 성능과 효율성 모두 갖춘 추론 워크로드도 실행할 수 있다. 인텔 개발자 클라우드는 개방형 멀티 아키텍처, 멀티 벤더 프로그래밍 모델인 원API가 포함된 개방형 소프트웨어를 기반으로 하드웨어 선택과 독점 프로그래밍 모델로부터의 자유를 제공해 컴퓨팅 가속화, 코드 재사용 및 휴대성을 지원한다.

- 인텔 디스트리뷰션 오브 오픈비노(Intel Distribution of OpenVINO) 툴킷 2023.1 릴리스: 오픈비노는 클라이언트 및 엣지 플랫폼에서 개발자를 위한 인텔의 AI 추론 및 배포 지원툴이다. 해당 릴리스에는 운영 체제 및 다양한 클라우드 솔루션 간의 통합에 최적화된 사전 학습된 모델이 포함되어 있으며, 메타(Meta)의 라마 2(Llama 2) 모델과 같은 다양한 생성형 AI 모델도 포함된다. 이날 무대에서는 선수들의 경기력을 평가하는AI.IO와 소비자가 더 잘 맞는 옷을 찾을 수 있도록 돕는 핏매치(Fit:Match)를 비롯한 기업들이 오픈비노를 사용해 애플리케이션을 가속화하는 방법을 시연했다.

- 스트라타 프로젝트(Project Strata)와 엣지 네이티브 소프트웨어 플랫폼 개발: 해당 플랫폼은 프리미엄 서비스 및 지원 제공과 함께 2024년에 출시 예정이다. 지능형 엣지 및 하이브리드 AI에 필요한 인프라를 확장하기 위한 수평적 접근 방식으로, 인텔 및 제3자 수직 애플리케이션의 에코시스템을 통합할 것이다. 이 솔루션을 통해 개발자는 분산된 엣지 인프라와 애플리케이션 구축, 배포, 실행, 관리, 연결 및 보호할 수 있다.

[테크수다 기자 도안구 eyeball@techsuda.com]

테크가 전 산업 영역에 스며드는 소식에 관심이 많다. 1999년 정보시대 PCWEEK 테크 전문지 기자로 입문한 후 월간 텔레닷컴, 인터넷 미디어 블로터닷넷 창간 멤버로 활동했다. 개발자 잡지 마이크로소프트웨어 편집장을 거쳐 테크수다를 창간해 지금까지 활동하고 있다. 태블릿을 가지고 얼굴이 꽉 찬 방송, 스마트폰을 활용한 현장 라이브를 한국 최초로 진행했다.

.jpg)